Finews

台灣最好懂得財經、科技新聞網!

帶給你最有用的新聞資訊。

Finews

台灣最好懂得財經、科技新聞網!

帶給你最有用的新聞資訊。

人工智慧時代來臨,數據就像新時代的石油,成為訓練機器學習模型的關鍵動力。全球企業往往對自家專有數據守口如瓶,這讓AI研究團隊陷入嚴重的數據短缺困境。就在這種情況下,Mercor這家公司脫穎而出,它以獨特的方式充當AI模型與所需數據之間的橋樑,讓OpenAI和Meta等領先實驗室能夠取得那些企業不願輕易讓出的珍貴資源。

訓練AI模型需要大量優質數據,涵蓋文字、影像和聲音等多種形式。這些數據的品質和多樣性,直接決定模型的表現和適應能力。但許多公司為了維持競爭優勢、保護隱私或守住智慧財產權,寧可將數據藏在自家庫房,也不願外流。這讓AI開發者即使手握頂尖演算法和強大運算力,也常常卡在數據不足的關卡,進展緩慢。

Mercor看準了這個產業痛點,不去直接向企業要數據,而是打造了一個遍及全球的承包商團隊。這些承包商靠人力,從公開或半公開管道蒐集、整理、標記和檢查數據,轉換成AI模型能直接運用的形式。根據TechCrunch的報導,Mercor已經向超過30萬名全球承包商支付逾15億美元,這數字凸顯它在數據供應鏈中的關鍵角色。AOL的報導也點出Mercor在酬勞承包商上的巨額投入。這種人與機器結合的作法,讓Mercor避開傳統數據分享的障礙,為AI團隊提供迫切需要的訓練素材,推動整個AI領域更快前進。

Mercor的數據蒐集主要靠它的廣大承包商網。這些人可能從網頁抓取公開內容、轉寫音訊檔案、標記圖片中的物件、修改文本內容,甚至驗證事實真偽。這種方法的強項在於彈性和大規模運作,能應對各種棘手數據類型,並依AI模型需求量身打造。

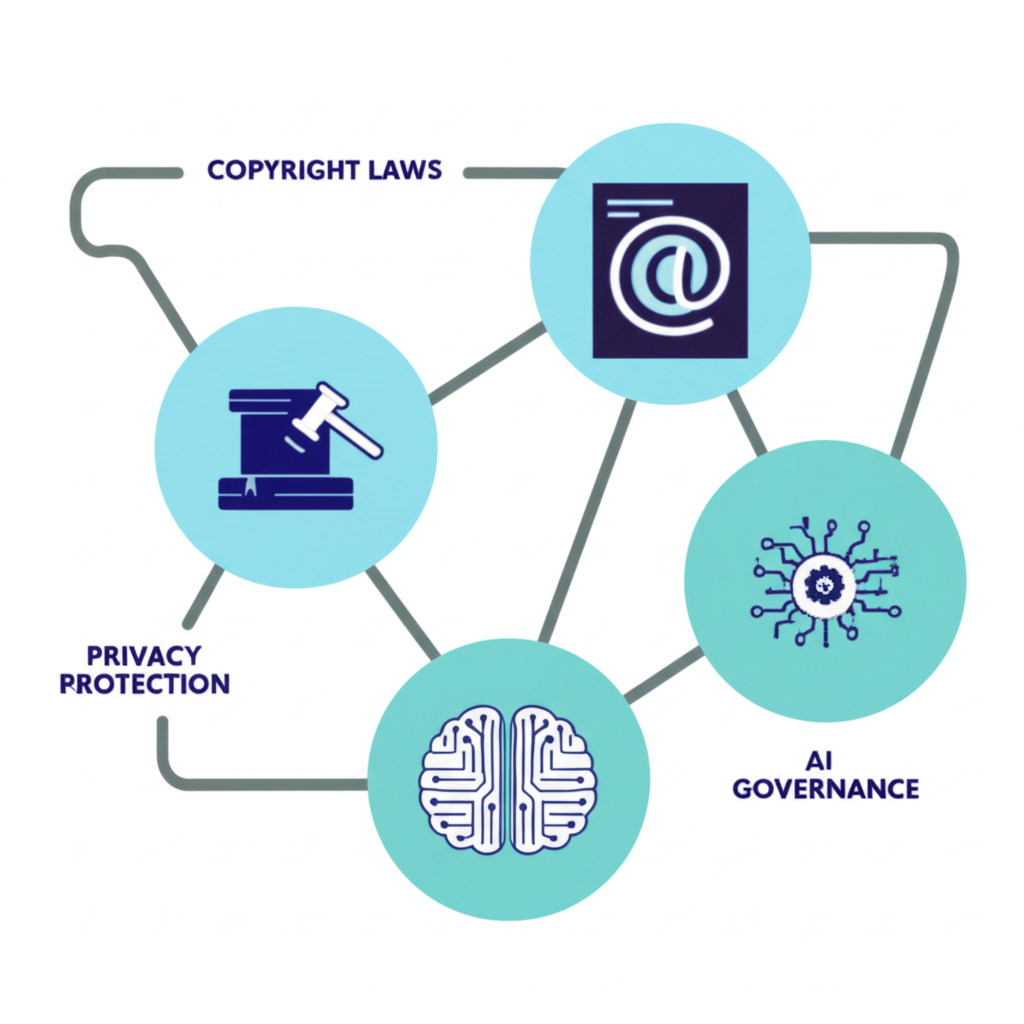

不過,這種運作也引發不少道德和法律疑慮。首先,數據來源的合法性和公開程度常常曖昧不明。Mercor強調使用公開數據,但什麼算「公開」並非絕對,後續再利用可能觸及原擁有者的智慧財產權。其次,隱私風險不容忽視。即使數據看似匿名,經過處理後仍可能被逆向辨識,威脅個人權益。比如歐盟的《通用數據保護條例》(GDPR)對數據處理有嚴格規範,任何涉及個人資訊的步驟都得確保合法、公正和透明,正如GDPR官方資訊所載。此外,AI產業在急速擴張中,也正面臨數據倫理和管理的挑戰。布魯金斯學會的報告就強調,創新與責任的平衡是核心議題。為了加深理解,我們可以想想實際案例:某些公開社群媒體數據雖可免費取得,但若用於商業AI訓練,是否需額外取得同意,這仍是業界熱議焦點。

Mercor的服務對AI產業,尤其是大型語言模型的進展,帶來重大助力。OpenAI、Meta這些先驅實驗室,加上Scale AI等數據標註夥伴,都曾借助Mercor類似平台來滿足海量數據需求。Livemint的報導指出,這種夥伴關係大大加快了這些機構的模型更新和創新速度。

隨著全球AI市場持續膨脹—Statista數據顯示市場規模正穩步攀升—對優質訓練數據的渴求只會更強烈。Mercor的模式預示數據供應鏈將變得更多元、更多層,但伴隨而來的數據倫理和監管壓力也將加劇。如何在滿足AI需求之餘,保障數據合法來源、用戶隱私和智慧財產權,將考驗這些平台的智慧。未來,強調數據透明、可追蹤和負責任治理的框架,將是AI產業穩健成長的基石。

Mercor的興起,突顯AI時代數據的核心價值,以及獲取途徑的轉變。它連結AI實驗室與全球數十萬承包商,化解企業數據封閉帶來的瓶頸,讓OpenAI和Meta等領軍者加速創新。但這種效率背後,也喚起對數據合法性、隱私保障和權利尊重的深入反思。展望前方,Mercor等企業需在創新與倫理、速度與規範間尋求最佳平衡,確保AI在可靠的道路上前行。

Mercor 是一家專門協助人工智慧(AI)實驗室獲取訓練數據的公司。由於許多企業不願分享其專有數據,Mercor 透過其龐大的全球承包商網絡,手動收集、標註和驗證數據,以滿足 AI 模型對海量數據的需求。

Mercor 不直接向企業索取數據,而是僱用全球數十萬名承包商。這些承包商執行各種數據相關任務,例如從公開來源收集資訊、轉錄音訊、標註圖像或撰寫文本,將這些原始數據轉化為 AI 模型可用的訓練資料。

根據報導,包括 OpenAI 和 Meta 在內的頂尖 AI 實驗室,以及像 Scale AI 這樣的數據標註服務商,都曾與 Mercor 或其類似的數據供應商合作,以獲取其 AI 模型訓練所需的數據。

主要的考量包括:

Mercor 的模式加速了 AI 模型的訓練和創新,特別是對大型語言模型(LLM)的發展至關重要。它解決了 AI 實驗室的數據瓶頸問題,使得更多元、更高效的 AI 模型得以開發。然而,這也促使產業重新審視數據倫理與治理的重要性。